Ingenieure der FAU entwickeln neues Abtastverfahren digitaler Bildsensoren

Pixeltrick für schärfere Bilder

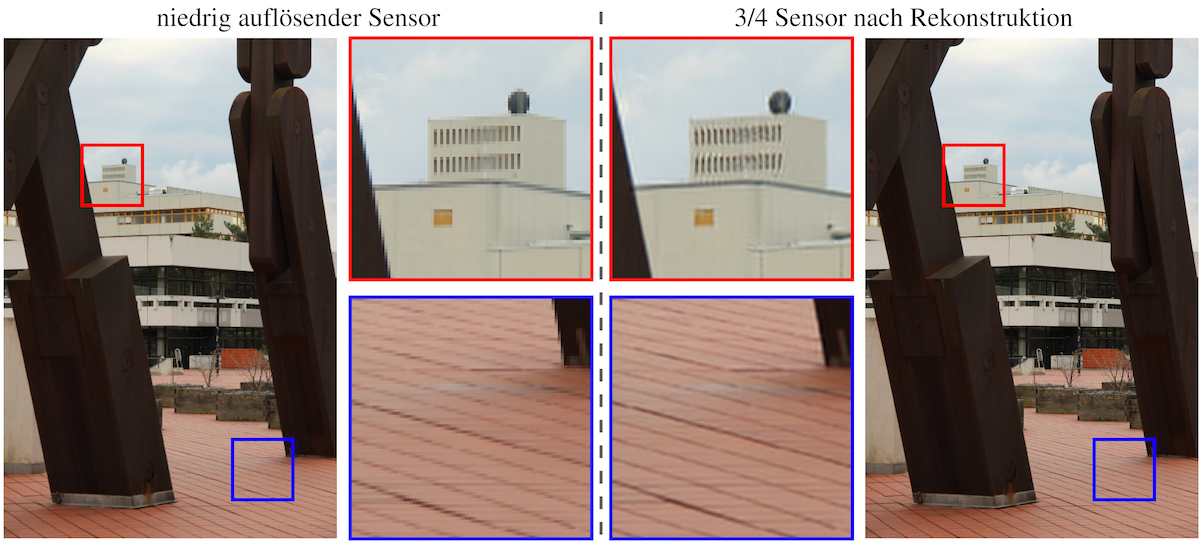

Ingenieure der FAU haben ein Verfahren entwickelt, das die Auflösung digitaler Kameras um das Vierfache erhöht, ohne dafür größere und teurere Bildsensoren einsetzen zu müssen. Erreicht wird das durch unregelmäßiges Abtasten der Pixel und nachträgliche Bildrekonstruktion. Im nächsten Schritt soll ein Prototyp entworfen werden, an dem weiter geforscht werden kann.

Jeder, der ein Smartphone besitzt, hat auch eine Kamera dabei. Genauer gesagt: eine Digitalkamera. Ihr Herzstück ist der Bildsensor, der das einfallende Licht in ein digitales Signal umwandelt. Dafür ist er in kleine Sektoren aufgeteilt, die sogenannten Bildpunkte oder Pixel, die die Intensität des Lichts messen. Die Auflösung einer Kamera, also die Wiedergabe feinster Strukturen, zu verbessern, war bislang fast ausschließlich durch eine Erhöhung der Pixelzahl möglich. „Dafür müssen entweder größere und teurere Sensoren gebaut oder aber die Bildpunkte extrem verkleinert werden, was technisch nur bis zu einem bestimmten Grad möglich ist“, sagt Dr. Jürgen Seiler vom Lehrstuhl für Multimediakommunikation und Signalverarbeitung der FAU. „Außerdem verstärken sich mit der zunehmenden Miniaturisierung der Pixel Störungen im Bild, die als Rauschen bezeichnet werden.“

Regelmäßige Anordnung führt zu Aliasing

Wie aber lässt sich die Auflösung von Bildsensoren verbessern, ohne dafür die Anzahl der Pixel erhöhen zu müssen? Seit Jahren arbeiten Seiler und seine Lehrstuhlkollegen an diesem Problem. Ihr Lösungsansatz: Im Gegensatz zum konventionellen Verfahren werden die Bildpunkte nicht regelmäßig, sondern unregelmäßig abgetastet. „Jeder Bildpunkt hat einen lichtsensiblen Bereich, aber auch Stellen, an denen kein Licht detektiert wird“, erklärt Jürgen Seiler. „Bei herkömmlichen Sensoren werden sämtliche Pixel in einem Raster gleichmäßig ausgerichtet, was zu starken Aliasing-Artefakten führt.“ Aliasing äußert sich in gestuften Verläufen von Helligkeitskanten oder störenden Mustern in periodischen Bildinhalten. Diesen Effekt kann man beispielsweise beobachten, wenn ein Fernsehmoderator ein sehr fein kariertes Sakko trägt und sich plötzlich bunte Flecken zeigen.

Viermal höhere Auflösung durch rotierte Bildbereiche

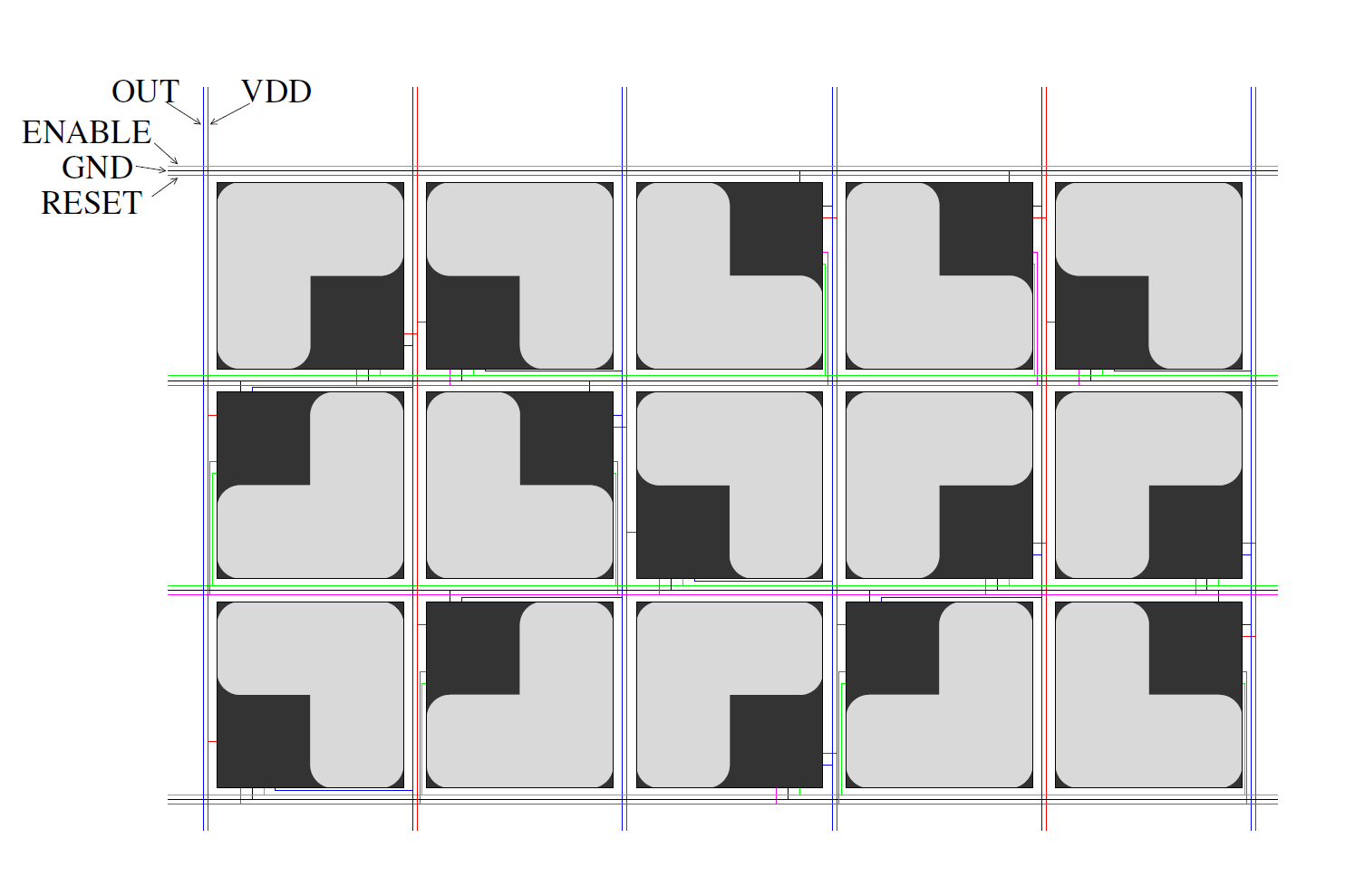

Die FAU-Forscher konnten nun zeigen, dass sich das Aliasing durch eine unregelmäßige Abtastung effektiv verringern lässt. Dabei bedienen sie sich eines Tricks: Die quadratischen Bildpunkte sind zwar nach wie vor in einem regelmäßigen Raster angeordnet, aber sie werden gegeneinander rotiert, so dass die lichtempfindlichen Bereiche nicht exakt auf einer Linie liegen. „Man kann sich das vorstellen wie bei Wandfliesen mit einem Dekorstreifen“, sagt Jürgen Seiler. „Werden die Fliesen um jeweils 90 Grad gedreht, entsteht kein durchgehender Streifen, sondern ein unregelmäßiges Muster.“ In einem nachgeschalteten Verfahren, das am Lehrstuhl entwickelt wurde, wird das Bild rekonstruiert. Mit dieser Methode erreichen die Ingenieure eine viermal so hohe Auflösung wie bei einer regelmäßigen Abtastung – bei gleicher Anzahl der Bildpunkte. Möglich wird dies dadurch, dass Bildsignale typischerweise durch eine kleine Anzahl dominanter Frequenzen beschrieben werden können – ein Effekt, der auch bei der Komprimierung von Audiodateien genutzt wird.

Prototyp für weitere Forschung

Die Kombination aus unregelmäßiger Abtastung und nachgeschalteter Verarbeitung erlaubt es, entweder eine deutlich höhere Qualität mit der gleichen Anzahl an Bildpunkten zu erreichen, oder aber für die gleiche Bildqualität die Anzahl der Pixel um den Faktor vier zu reduzieren. Hersteller digitaler Kameras können mit dieser Lösung nicht nur Kosten sparen, sondern auch den Energieverbrauch der Geräte reduzieren. Noch befindet sich die Methode im Simulationsstadium – schon bald aber soll ein Hardware-Prototyp entwickelt werden, an dem weitere Messungen vorgenommen werden können.

Weitere Informationen:

Dr. Jürgen Seiler

Tel.: 09131/85-27102

juergen.seiler@fau.de